Výzkumníci použili AI k vytvoření způsobu, jak zlepšit kvalitu a zdvořilost online diskusí týkajících se polarizujících témat tím, že uživatelům poskytují návrhy na přeformulování jejich komentářů předtím, než je zveřejní. Říká se, že správně použitá umělá inteligence by mohla být použita k vytvoření laskavější a bezpečnější digitální krajiny.

Online konverzace nyní hrají ústřední roli ve veřejném diskurzu. Sekce komentářů na platformách sociálních médií a digitálních zpravodajských kanálech jsou však plné diskuzí, které se zvrhly v argumenty, hrozby a nadávky, zejména tam, kde se diskuse týká rozdělujícího tématu.

Nyní výzkumníci z Brigham Young University (BYU) a Duke University vyvinuli AI, která dokáže moderovat online chaty, zlepšuje jejich kvalitu a podporuje zdvořilost.

Pro svůj terénní experiment naverbovali 1 574 účastníků a požádali je, aby se zapojili do online diskuse o regulaci zbraní v USA, což je sporný problém, který se často objevuje v kontextu politické debaty. Každý účastník byl spojen s někým s opačným názorem na politiku zbraní.

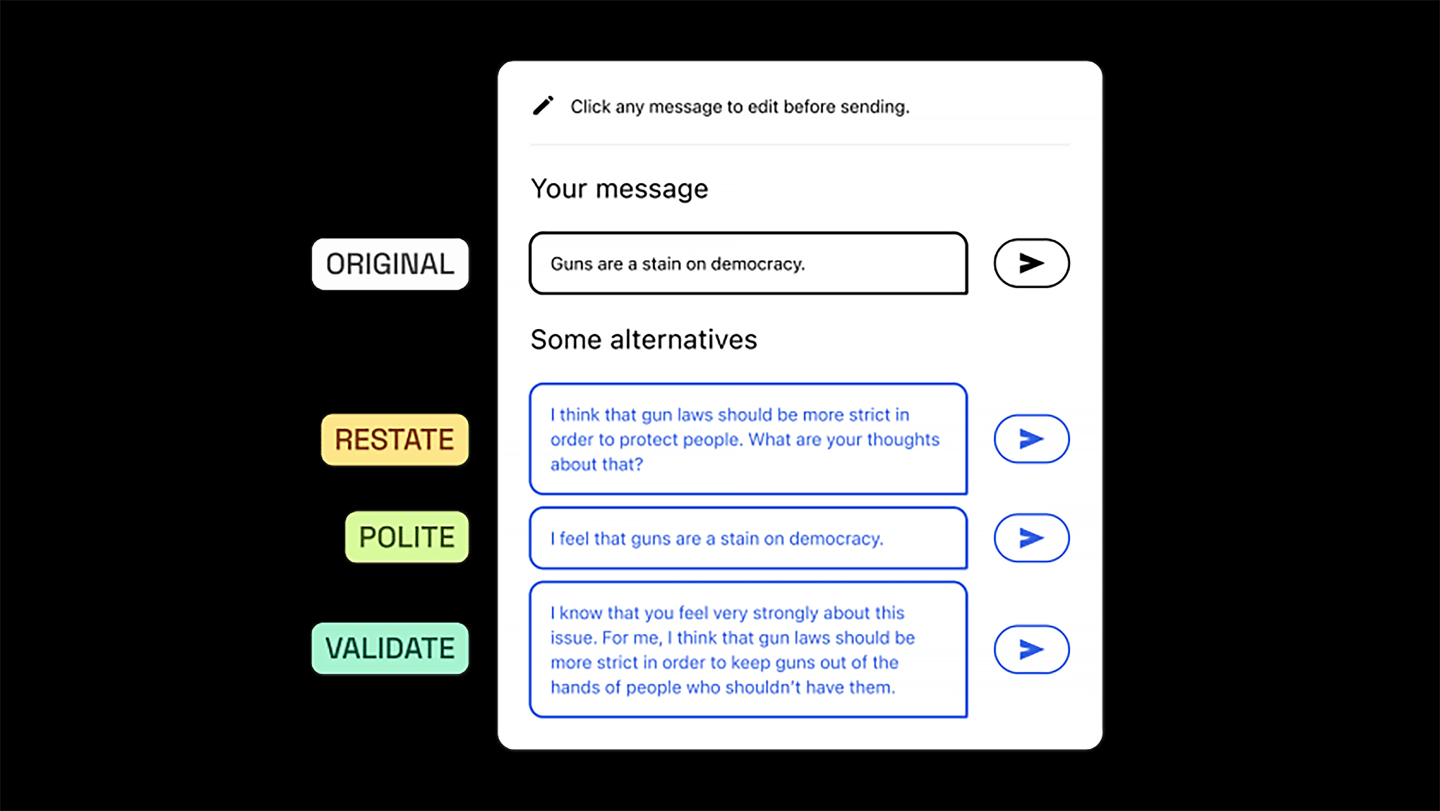

Po shodě byly konverzační páry náhodně přiřazeny k léčebnému nebo kontrolnímu stavu a partneři pokračovali v rozhovoru. V ošetřené konverzaci obdržel jeden účastník od GPT-3 tři návrhy na přeformulování své zprávy před jejím odesláním. Účastníci si mohli vybrat, zda pošlou jednu ze tří alternativ navržených umělou inteligencí, svou původní zprávu, nebo jakoukoli zprávu upraví.

Vin Howe/BYU

V průměru bylo v každé konverzaci odesláno 12 zpráv, přičemž bylo navrženo celkem 2 742 přeformulování generovaných AI. Účastníci akceptovali přeformulování navržené AI ve dvou třetinách případů. Chatoví partneři jednotlivců, kteří implementovali jeden nebo více návrhů na přeformulování umělé inteligence, uváděli výrazně vyšší kvalitu konverzace a byli ochotnější naslouchat perspektivám svých politických oponentů.

„Zjistili jsme, že čím častěji byly přeformulování používány, tím pravděpodobněji měli účastníci pocit, že konverzace není rozdělující a že se cítí slyšet a rozumět,“ řekl David Wingate, jeden ze spoluautorů studie.

Vědci tvrdí, že jejich zjištění naznačují, že toto škálovatelné řešení by mohlo bojovat proti toxické online kultuře, která pronikla internetem. Říkají, že by to bylo snazší implementovat než například profesionální školení o online zdvořilosti, jejichž rozsah a dostupnost jsou omezené, protože intervence umělé inteligence by mohla být široce implementována napříč různými digitálními kanály.

Nakonec, říkají vědci, tento výzkum ukazuje, že správně používaná umělá inteligence může hrát důležitou roli při vytváření pozitivnějšího online prostředí a podporovat diskuse, které jsou empatické a respektující.

„Doufám, že budeme i nadále mít více studentů BYU, kteří budou vytvářet prosociální aplikace, jako je tato, a že se BYU může stát lídrem v demonstrování etických způsobů používání strojového učení,“ řekl Wingate. „Ve světě, kterému dominují informace, potřebujeme studenty, kteří dokážou jít ven a hádat se s informacemi z celého světa pozitivním a společensky produktivním způsobem.“

Studie byla publikována v časopise PNAS.

Zdroj: Univerzita Brighama Younga

Čerpáme z těchto zdrojů: google.com, science.org, newatlas.com, wired.com, pixabay.com